Technologie. Spróbuję czytać w twoich myślach

Często jest tak, że mamy w głowie jakiś obraz, wyobrażenie czegoś nieistniejącego, jakąś myśl, którą chcielibyśmy się podzielić z innymi, ale jakoś trudno nam przedstawić to, co mamy w głowie. Tymczasem wiadomo, że człowiek lepiej rozumie to, co widzi. Okazuje się, że są narzędzia, które czynią możliwym to, co wydaje się niemożliwe.

Każdy z nas odbiera świat inaczej. Dobrym przykładem jest proste ćwiczenie, w którym jedna osoba dostaje rysunek i jej zadaniem jest przekazanie jego treści za pomocą słów tak, by druga osoba mogła to namalować. Spróbujmy po lewej stronie kartki narysować prostą kreskę, a obok niej drugą, taką samą. Połączmy je na dole. Od górnej kreski narysujmy kolejną skośną. To samo zróbmy z drugą kreską. Na narysowanych kreskach narysujmy małe kółka. Co wyszło? A co autor miał na myśli? Jak ten obrazek widzi odbiorca? Każdy narysuje to samo, czy oczami wyobraźni zobaczy coś innego? Jak przekazać dokładnie naszą wizję?

Z pomocą przychodzi technologia

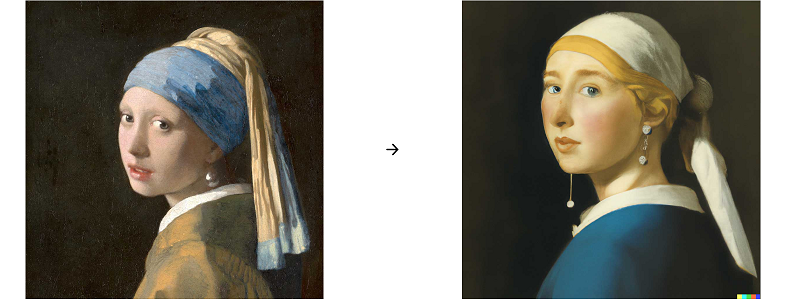

Niedawno powstały system DALL-E 2 tworzy obrazy, ale potrafi też dodawać nowe elementy do już istniejących. Pierwowzór został wydany na początku ubiegłego roku, a jego nazwa miała stanowić hołd dla słynnego malarza Salvadora Dali oraz nawiązanie do animacji WALL-E. Początkowo narzędzie tworzyło proste obrazy ukazujące na przykład manekina we flanelowej koszuli, ale z czasem przeszło do znacznie bardziej skomplikowanych koncepcji, takich jak rzodkiewka spacerująca z psem, delfin orbitujący wokół Saturna bądź astronauta jadący na koniu. Wszystko to w oparciu o zwykłe komendy tekstowe, które może wprowadzać osoba zupełnie niezaznajomiona z działaniem układów AI – pisze Aleksander Kowal w kwietniowym wydaniu magazynu Focus.

Dzięki tej technologii możliwe stało się tworzenie własnych grafik i obrazów przez osoby, które niekoniecznie mają odpowiednie umiejętności plastyczne. Wystarczy tylko albo aż wyobraźnia.

Czym jest DALL-E 2?

Najprościej mówiąc, to narzędzie działające za pomocą sztucznej inteligencji (AI). Tworzy wysokiej rozdzielczości obrazy na podstawie opisów tekstowych, podawanych w formie zdań. I jest w tym wszystkim nad wyraz elastyczne, bezproblemowo wprowadzając nawet najdrobniejsze zmiany w danych wyjściowych. Jest również w stanie przetwarzać gotowe obrazy, na przykład fotografie, wykorzystując dodatkowe elementy w oparciu o komendy głosowe. I nie chodzi o jakieś skomplikowane polecenia znane jedynie wtajemniczonym programistom czy specjalistom od sztucznej inteligencji, ale o zwykłe komendy, których używamy w języku potocznym. I to jest z pewnością wartość tego systemu, ale z drugiej strony też rewolucja w dzisiejszym postrzeganiu i tworzeniu grafiki oraz fotografii.

Twórcy narzędzia nie zakładają jednak negatywnych scenariuszy, bo na razie dostęp do systemu będzie istotnie limitowany. Chodzi im o to, aby nie upowszechnić narzędzia potencjalnie umożliwiającego proste generowanie „złych treści”. Dlatego na razie będzie ono w dyspozycji innych naukowców, którzy będą mogli je wykorzystać w badaniach.

Pozostaje pytanie, co stanie się w momencie, gdy tego typu narzędzie lub narzędzia się upowszechnią? Odpowiedź daje Maciej Luśtyk w artykule „Dotarliśmy do końca fotografii. Nowy system AI tworzy zdjęcia i grafiki na podstawie opisów” opublikowanym na stronie fotopolis.pl. Czytamy w nim: W krótkiej chwili zniknie konieczność zamawiania obrazów i zdjęć typowo ilustracyjnych czy korzystania ze stocków. Do tego typu pracy błyskawicznie zaadaptuje się także rynek komercyjny, gdzie klienci będą w stanie tworzyć niekończące się kreatywne aranżacje na bazie wprowadzonych przez siebie produktów.

Jak będzie – to pokaże czas. Na pewno nie zatrzymamy rozwoju technologii. Na pewno zmiany będą postępować i na pewno będą się rodzić (podobnie jak na przykład w przypadku muzyki) pytania o wartość dzieł tworzonych przez zaawansowane narzędzia z wykorzystaniem sztucznej inteligencji bardziej niż powstałych tradycyjnie w mózgu żywego człowieka.

Magdalena Woźniak

Zostaw komentarz